Die Chatbot-Ethik ist von wesentlicher Bedeutung, in einer Welt, in der künstliche Intelligenz immer häufiger in unterschiedlichen Bereichen eingesetzt werden, um Arbeitsabläufe zu verbessern und den Kundendienst zu verbessern. Hierbei ist die ethische Ausrichtung dieser Systeme eine kritische Rolle, um sicherzugehen, dass sie nicht bloß leistungsfähig, sondern auch gesellschaftlich akzeptabel sind. Die Einführung von ethischen Prinzipien in die KI-Entwicklung zielt darauf ab, das Vertrauen in die Nutzer zu festigen und sicherzustellen, dass die Technologie dem Wohle der Gesellschaft dient.

Verantwortung in der Gestaltung von Chatbots nimmt ihren Anfang in den ersten Schritten der Planung und erstreckt sich bis zur Implementierung und laufenden Überprüfung der Systeme. Unternehmen und Programmierer sind verpflichtet, dass die erschaffenen Chatbot-Lösungen nicht bloß leistungsfähig, sondern auch moralisch korrekt sind. Dieses Verantwortungsbewusstsein umfasst mehrere Facetten, von der Gestaltung benutzerfreundlicher Schnittstellen bis hin zur Gewährleistung, dass die Systeme keine schädlichen Auswirkungen auf die Nutzer haben.

Ein wichtiger Aspekt der moralischen Pflicht liegt darin, sicherzustellen, dass die Transparenz in allen Phasen des Betriebs von Chatbots erhalten bleibt. Anwender haben ein Anrecht darauf zu wissen, wie ihre persönlichen Daten genutzt werden und wie die Entscheidungen des Chatbots erarbeitet werden. Diese Klarheit hilft, das die Zuversicht zu stärken und sicherzustellen, dass die Nutzererfahrungen klar und verständlich sind.

Ein weiterer wesentlicher Aspekt besteht in der Vermeidung von Voreingenommenheit. Programmierer müssen sorgfältig darauf achten, dass ihre KI-Lösungen faire Entscheidungen treffen. Dies benötigt eine sorgfältige Analyse der Daten, die zur Schulung des Chatbots verwendet werden, sowie eine kontinuierliche Überwachung des Systems, um sicherzustellen, dass es keine diskriminierenden Muster entwickelt.

Letztendlich liegt die ethische Verantwortung bei den Organisationen und Designern, dafür zu sorgen, dass ihre Chatbots den strengsten moralischen Prinzipien entsprechen. Dies benötigt nicht nur technisches Wissen, sondern auch ein genaues Wissen über die moralischen Herausforderungen, die mit der Erschaffung und dem Einsatz von KI-Systemen verbunden sind.

Nachvollziehbarkeit spielt eine entscheidende Rolle in der ethischen Gestaltung von Chatbots und ist grundlegend bei der Gewinnung von Vertrauen zwischen Nutzern und Chatbot-Plattformen. In der heutigen digitalen Ära, in der künstliche Intelligenz in immer mehr Alltagsbereichen verwendet werden, ist es von hoher Relevanz, dass die Technologieprozesse offen und verständlich ist. Nur durch Transparenz kann gewährleistet werden, dass die Nutzer das volle Vertrauen in die von ihnen genutzten Systeme haben.

Ein wichtiger Punkt der Offenheit ist die eindeutige Identifizierung von Chatbots. Verbraucher sollten immer wissen, wann sie es mit einem KI-System zu tun haben. Diese Deutlichkeit ist nicht nur entscheidend, um Fehlinterpretationen zu verhindern, sondern auch, um die Vorstellungen der Anwender in Bezug auf die Fähigkeiten des Systems zu steuern. Eine klare Deklaration kann helfen, das Vertrauen der Anwender in die Technologie zu stärken und zu garantieren, dass sie das den Chatbot in einer Weise nutzen, die ihren Erwartungen gerecht wird.

Ein weiterer wesentlicher Faktor der Nachvollziehbarkeit ist die klare Kommunikation über die Datenverarbeitung und Algorithmen, die den Chatbot steuern. Verbraucher sollten in der Lage sein, klar zu erkennen, wie ihre Informationen erfasst, angewendet und verarbeitet werden. Diese Klarheit kann durch detaillierte Datenschutzerklärungen und durch die Erklärung der KI-Funktionalitäten sichergestellt werden. Eine solche Offenlegung ist besonders wichtig in Bereichen wie dem Gesundheitswesen oder der Bankwesen, wo Entscheidungen des Chatbots weitreichende Auswirkungen haben können.

Die Transparenz umfasst auch die kontinuierliche Überwachung und Anpassung der Systeme. Organisationen sollten transparenz machen, wie wann und unter welchen Umständen ihre KI-Lösungen angepasst werden und welche Schritte unternommen werden, um sicherzustellen, dass die Systeme weiterhin fair und ausgewogen arbeiten. Diese Transparenz fördert, das Vertrauen der Nutzer zu stärken und sicherzustellen, dass die Systeme in einer gesellschaftlich akzeptierten Art arbeiten.

Gerechtigkeit stellt einen unverzichtbaren Bestandteil dar in der Ethik der KI-Entwicklung und essentiell für die Gestaltung von Chatbots. Chatbots sollten so programmiert werden, dass sie gerecht und fair handeln und keine voreingenommenen Urteile fällen. Dies hat besondere Bedeutung in einer Umgebung, in der künstliche Intelligenz immer stärker in der Arbeitswelt, der medizinischen Betreuung und der Rechtspflege verwendet werden.

Um Unvoreingenommenheit zu erreichen, müssen Programmierer darauf achten, dass die Algorithmen, die die Chatbots antreiben nicht auf voreingenommenen Daten basieren. Dies setzt voraus eine detaillierte Analyse der Datenbasis, um sicherzustellen, dass sie fair und ausgewogen. Darüber hinaus sollten read more Chatbots kontinuierlich überprüft werden, um sicherzustellen, dass sie keine diskriminierenden Muster entwickeln.

Ein weiterer wesentlicher Faktor der Fairness besteht in der Einbeziehung unterschiedlicher Perspektiven in das Team von Programmierern. Vielfältige Sichtweisen können dazu beitragen, potenzielle Biases zu erkennen und zu korrigieren, bevor sie zu einem schädlichen Auswirkungen führen. Dies kann durch die Zusammenarbeit mit einem vielfältigen more info Team erreicht werden, die ihre individuellen Sichtweisen in den Designprozess einbringen.

Die Unvoreingenommenheit sollte auch in der Nutzererfahrung erhalten bleiben. KI-Systeme sollten so gestaltet sein, dass sie alle Verbraucher gerecht behandeln und ihre Bedürfnisse und Anliegen auf faire und gerechte Weise behandeln. Dies benötigt eine sorgfältige Gestaltung der Nutzeroberfläche und get more info der Interaktionsprozesse, um sicherzustellen, dass keine Personengruppe diskriminiert oder bevorzugt wird.

Die Bias-Vermeidung ist eine der größten Herausforderungen in der moralischen Entwicklung von KI und setzt voraus dauerhafte Maßnahmen der Entwickler und Organisationen. Bias kann in vielen Formen auftreten und die Antworten eines Systems auf unbemerkte oder klare Weise beeinflussen. Es ist daher wichtig, dass Schritte unternommen werden, um sicherzustellen, dass künstliche Intelligenz faire Urteile fällen.

Ein erster wichtiger Schritt in der Bias-Vermeidung ist es, die verwendeten Trainingsdaten gründlich zu prüfen. Es ist wichtig, dass die Daten repräsentativ für die gesamte Nutzerbasis sind und keine diskriminierenden Tendenzen haben. Darüber hinaus sollten die Trainingsdaten laufend überprüft werden, um sicherzustellen, dass sie die neuesten gesellschaftlichen Entwicklungen widerspiegeln.

Ein weiterer zentraler Aspekt ist die Analyse der zugrunde liegenden Algorithmen, die den Systemablauf beeinflussen. Diese Algorithmen sollten kontinuierlich überprüft und optimiert werden, um sicherzustellen, dass sie keine unfairen Tendenzen folgen. Dieser Prozess benötigt eine Kombination aus technischer Expertise und ethischem Bewusstsein, um sicherzustellen, dass die Systeme ethisch vertretbar arbeiten.

Die Verhinderung von Voreingenommenheit benötigt die Integration von Diversität in den Designprozess. Vielfältige Sichtweisen und Hintergründe können es ermöglichen, potenzielle Biases frühzeitig zu erkennen und zu korrigieren. Dies kann durch die Einbeziehung von Teammitgliedern mit vielfältigen Erfahrungen erreicht werden, die ihre besonderen Erfahrungen in den Schaffungsprozess einbringen.

Am Ende stellt die Bias-Vermeidung einen fortlaufenden Prozess dar, der ständige Überwachung und Anpassung erfordert. Programmierer und Organisationen müssen entschlossen sein, ihre Systeme regelmäßig zu überprüfen und anzupassen, um sicherzustellen, dass sie weiterhin den striktesten moralischen Prinzipien entsprechen.

Ross Bagley Then & Now!

Ross Bagley Then & Now! Marques Houston Then & Now!

Marques Houston Then & Now! Danny Pintauro Then & Now!

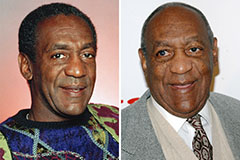

Danny Pintauro Then & Now! Bill Cosby Then & Now!

Bill Cosby Then & Now! Kerri Strug Then & Now!

Kerri Strug Then & Now!